무한한 심해 탐험

[PPT 리뷰] Improved Precision and Recall Metric for Assessing Generative Models 본문

[PPT 리뷰] Improved Precision and Recall Metric for Assessing Generative Models

유진쟝 2021. 1. 19. 22:41논문 출처 : NeurIPS 2019: Improved Precision and Recall Metric for Assessing Generative Models

주의할 점 : 논문을 다 해석하려고 하지 말고 (1) 문제점 도출 -> (2) 실험 결과 -> (3) 문제점에서의 개선점 및 앞으로의 목표 등 5장으로 줄여서 리뷰하기 (앞으로.. 그렇게 하겠다.. 허허)

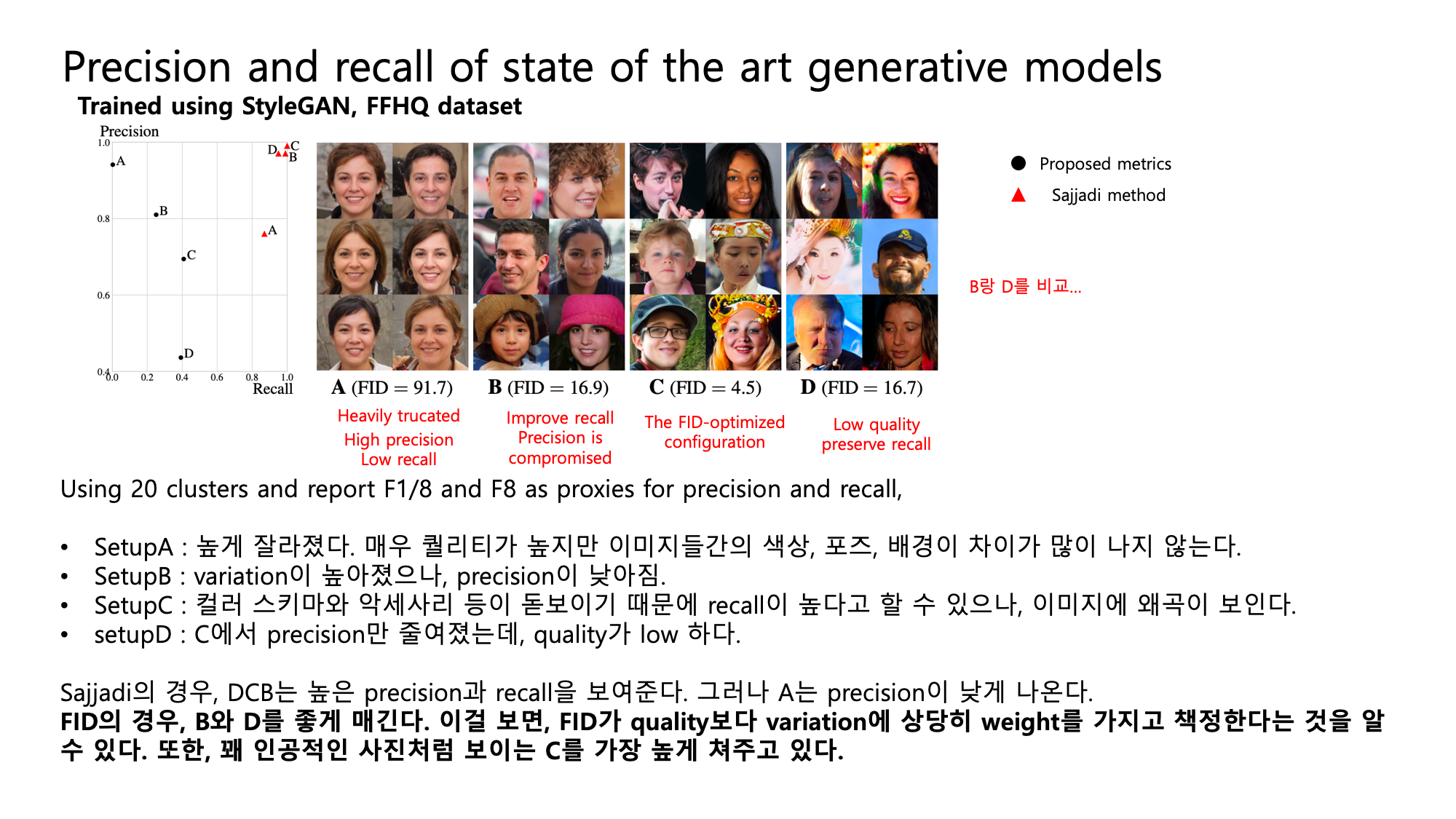

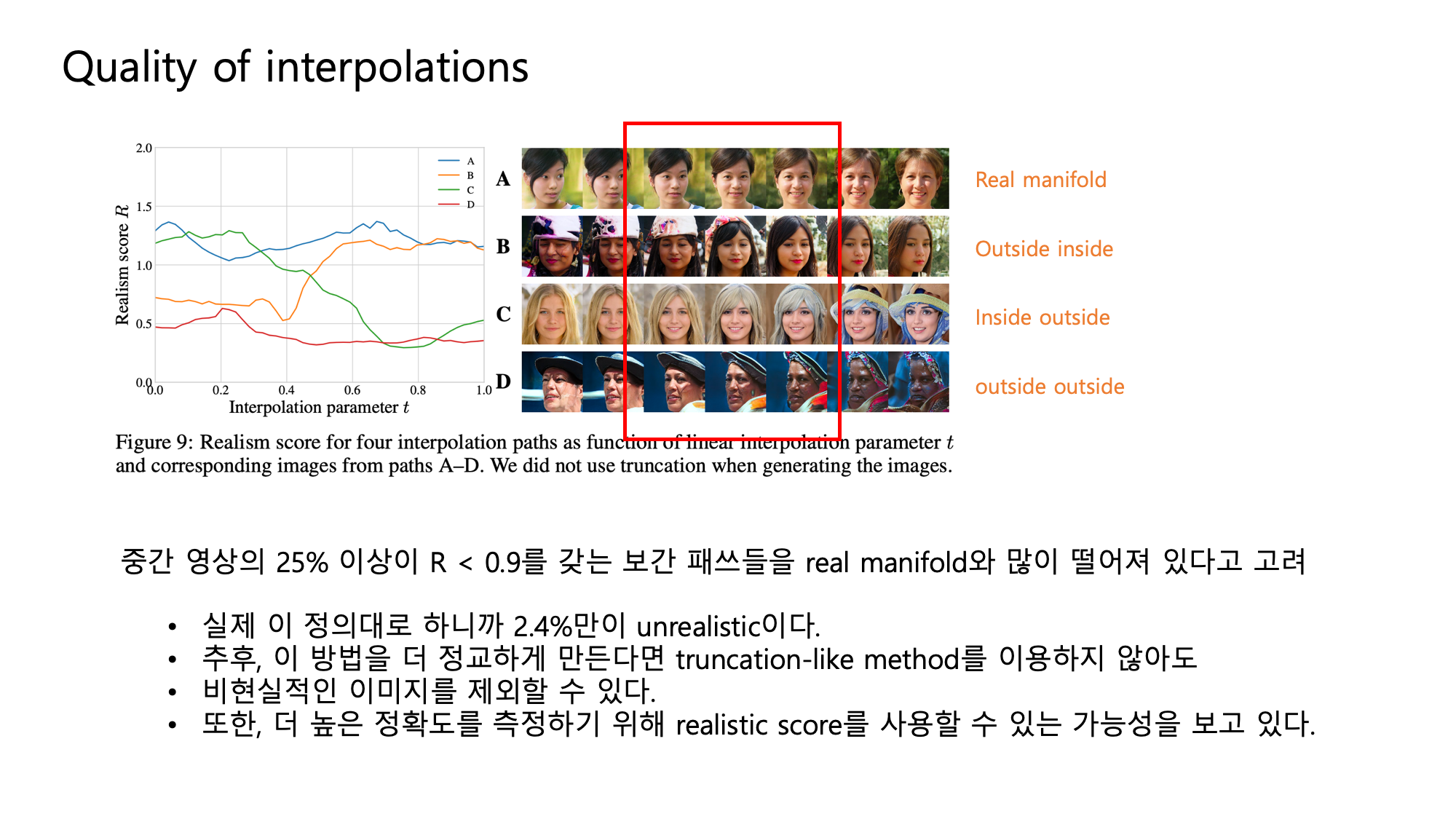

개인적인 논문 감상(?) : 사실 모델 학습 방식의 종류에 따라 trade off이 달라진다고 했는데, 기존에 알고 있던 미니배치 등 뿐만 아니라 다양한 Training Configuration들이 있다는 것을 알게 되었고, 이 configuration을 적용함으로써 발생하는 타당한 상관관계로 인해 precision과 recall의 값을 변화시킨다는 것을 알게 되었다.

또한, 그래프와 예시 그림들을 보고 분석하는 것이 처음에는 쉽지 않았는데, 계속해서 같은 논문을 읽어봄으로써 해당 그래프들이 어떤 내용을 뜻하는지 이해할 수 있게 되었고, 이게 해석을 하는데 더욱 도움을 주었다. (하지만 그림이 없다면..? 아마 그 날은...영어의 늪에 빠질 것이다.)

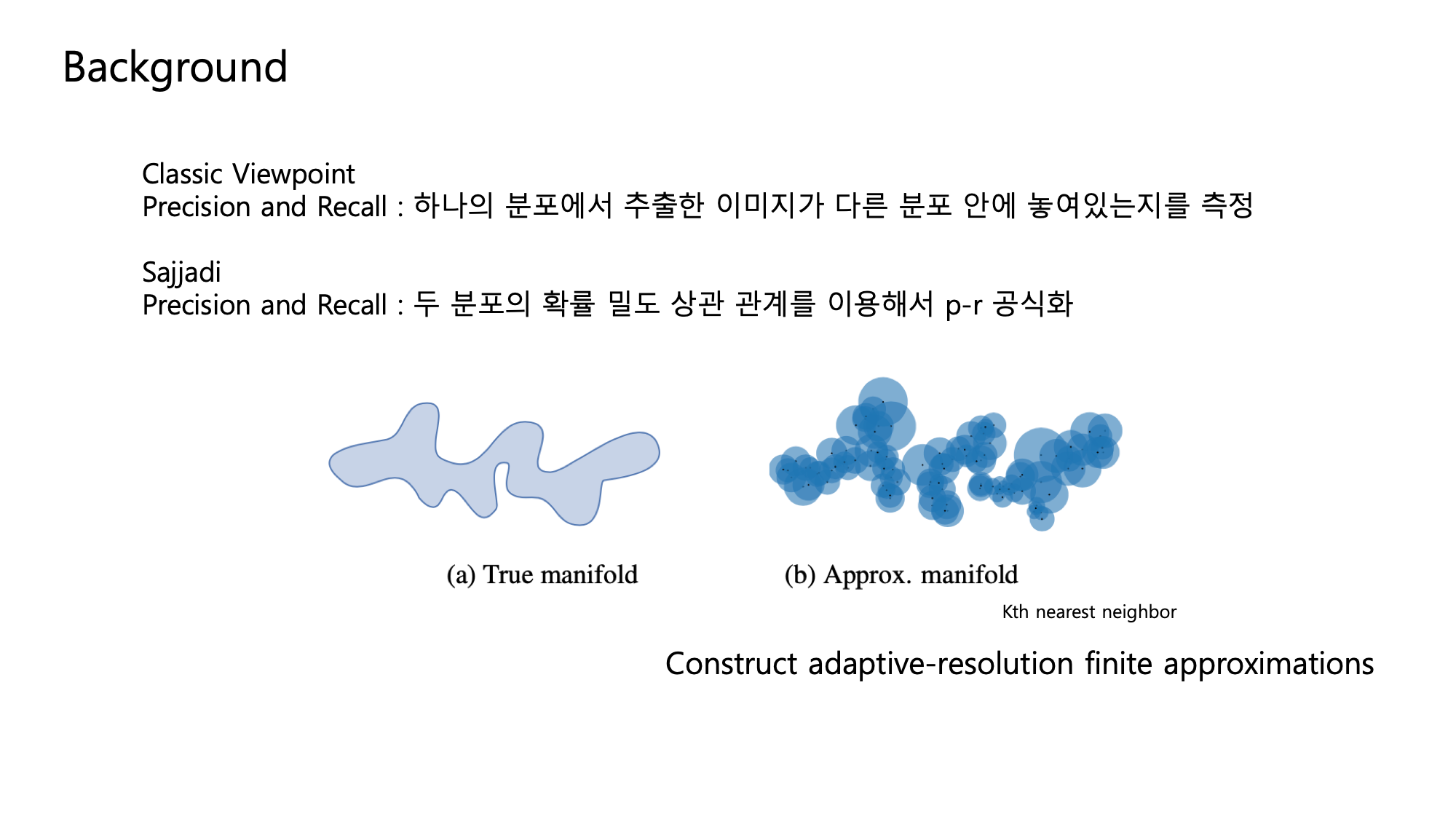

해당 논문에서는 내가 이해할 수 있는 정도의 수식이 나왔는데, 다행히 이해를 할 수 있어서 쉽게 읽혔다. 다만, 위상수학을 배워야 하나 고민을 하게 되었다. 벡터 그리고 distance와 관련한 개념들이 자주 나오는데 (사실 고등학생 때 기하와 벡터를 안 배웠...다 .행렬을 배운것은 다행이라고 여겨야 하나), 이 개념들과 기계학습 지식들을 연결 지으려니 상당히 기초지식들이 많이 필요하다는 것을 알게 되었다. 사실 인공지능 모델 관련한 내용들은 다시 설명해보라고 하면 쉽지는 않다. 왜냐하면 사실 몇 부분은 벼락치기의 결과로 인해 까먹었기 때문이다. CNN 레이어 구조라든지 학습 최적화 기법 같은 내용들은 책이나 인터넷 자료를 보면서 복습하는 시간이 필요할 것 같다. (언제할까..)